主題四:微軟的四道緊箍咒——被鎖死的 AI 帝國

核心論點

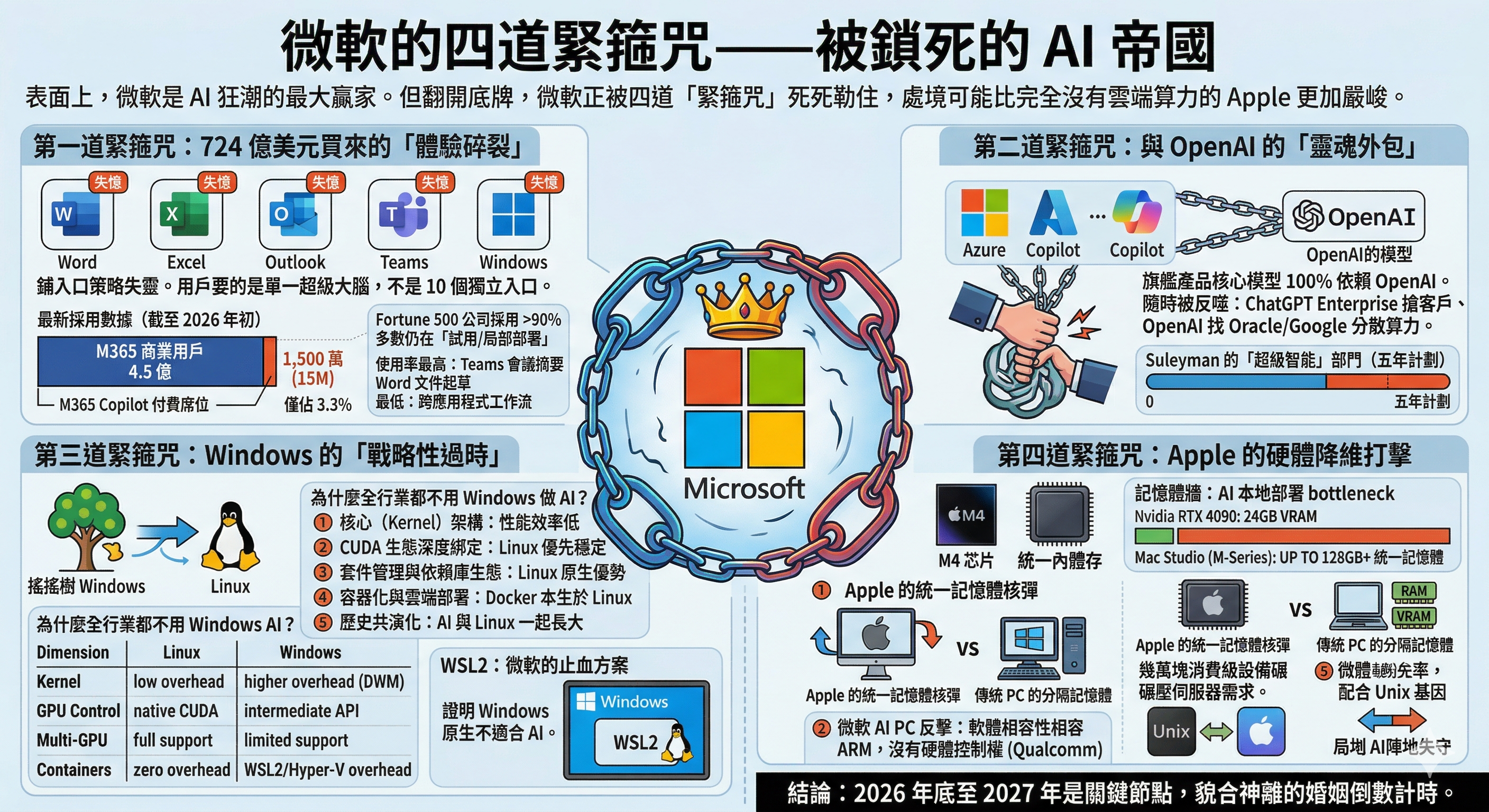

表面上,微軟是 AI 狂潮的最大贏家。但翻開底牌,微軟正被四道「緊箍咒」死死勒住,處境可能比完全沒有雲端算力的 Apple 更加嚴峻。

第一道緊箍咒:724 億美元買來的「體驗碎裂」

問題的起源

過去兩年,微軟的 AI 戰略可以用一個詞概括:「鋪入口」。把 Copilot 塞進 Word、Excel、Outlook、Edge、Teams、Windows 桌面——凡是微軟的產品,都插了一個 AI 按鈕。

微軟的邏輯是:我佔有全球最大的生產力軟體分發管道,用戶一定會買單。

現實打臉

最新採用數據(截至 2026 年初):

| 指標 | 數字 | 意義 |

|---|---|---|

| M365 商業用戶 | 4.5 億 | 微軟的生態基盤 |

| M365 Copilot 付費席位 | 1500 萬 | 僅佔商業用戶的 3.3% |

| 有權限者的實際使用率 | 約 35.8% | 買了的人裡也只有三分之一在用 |

| Fortune 500 公司採用 | >90% | 聽起來驚人,但多數仍在「試用/局部部署」階段 |

| 全面企業部署時間 | 12-18 個月外 | 離真正的規模化還很遙遠 |

使用率最高的場景:

- Teams 會議摘要(最高日活)

- Word 文件起草與摘要

- Outlook 郵件草擬

使用率最低的問題: 用戶最大的抱怨是**「體驗碎裂」——Word 裡的 Copilot 不知道你在 Excel 寫了什麼,每次打開都是一個「失憶」的全新助手。用戶需要的是一個跨應用程式、融入工作流的單一超級大腦**,不是 10 個獨立的 AI 入口。

更致命的發現: 獨立研究顯示,當員工同時能使用多個 AI 平台(ChatGPT、Gemini、Copilot)時,相當比例的活躍用戶更偏好非 Copilot 的替代品。微軟的分發優勢(強制預裝在 Office 裡)並不等於用戶忠誠度。

微軟的補救措施

2026 年 3 月,納德拉發起微軟史上最大規模的 Copilot 重組:

- 消費端與商用端 Copilot 團隊強行合併

- Jacob Andreou 晉升為 EVP of Copilot,直接向 CEO 匯報

- 2026 年的戰略重心從「實驗性採用」轉向「深度嵌入業務功能」——Security Copilot、Microsoft Fabric(數據分析)、Dynamics 365(銷售/服務)

但企業客戶的兩大障礙仍未解決:

- 數據準備度(非結構化、組織混亂的企業數據讓 AI 無法發揮)

- ROI 證明(每人每月 30 美元的溢價,企業需要看到可量化的回報)

第二道緊箍咒:與 OpenAI 的「靈魂外包」

這道緊箍咒在主題二已詳細分析。核心問題:

微軟所有旗艦 AI 產品的底層大腦,全部來自 OpenAI 的模型。 當 OpenAI 開始做 ChatGPT Enterprise 搶微軟的企業客戶、開始找 Oracle/Google 分散算力時,微軟的兩難是:

- 繼續依賴 OpenAI → 命脈捏在別人手裡

- 自研模型 → 至少需要 2-3 年,且沒有 OpenAI 十年的數據和研發積累

Suleyman 的「超級智能」部門是微軟的回應,但這是一個五年計劃——在這五年裡,微軟的「靈魂」仍然是借來的。

第三道緊箍咒:Windows 的「戰略性過時」——搖錢樹被整個行業繞過

重要澄清:不是只有微軟不用 Windows 做 AI——是「全行業都不用」

這道緊箍咒需要特別釐清一個常見的誤讀。問題不是「微軟用 Windows 做 AI 所以做不好」——事實上,沒有任何一家 AI 公司用 Windows 做核心 AI 開發:

| 公司 | AI 基礎設施跑什麼系統 |

|---|---|

| Google(TPU 集群) | Linux |

| Meta(AI 訓練集群) | Linux |

| OpenAI(Azure 上的 GPU 集群) | Linux |

| Amazon(AWS AI 服務) | Linux |

| 微軟自己(Azure 資料中心) | 超過一半的虛擬機��跑 Linux |

是的,你沒看錯——連微軟自己的 Azure 雲端,Linux 虛擬機的數量都已經超過 Windows 虛擬機。 微軟 CEO 納德拉早在 2015 年就公開說過「Microsoft loves Linux」,因為 Azure 的商業增長大部分來自 Linux 工作負載。

為什麼是 Linux?——技術層面的五大優勢

要理解為什麼全行業都選擇 Linux,必須先搞懂 AI 運算對作業系統的具體要求:

① 核心(Kernel)架構:為極致效能而生

Linux 的核心設計哲學是「一切皆檔案」,系統開銷極低。它沒有圖形介面(GUI)的強制負擔——在伺服器上跑 Linux,100% 的 CPU/記憶體/IO 資源都可以直接給 AI 訓練使用。

Windows 的核心則為桌面多工設計。即使在伺服器版本(Windows Server)中,桌面視窗管理員(DWM)和大量的背景服務仍會佔用系統資源。這個「設計基因」的差異不是幾行代碼能改的,而是四十年架構演化的結果。

② CUDA 生態的深度綁定

Nvidia 的 CUDA(統一運算架構)是 AI 訓練的事實標準——全球超過 90% 的深度學習模型都在 CUDA 上訓練。而 CUDA 的開發和優化從第一天起就以 Linux 為主要平台:

- CUDA SDK 在 Linux 上的更新永遠最先、最穩定

- 底層驅動在 Linux 上能跳過中間的 API 轉換層,直接與 GPU 硬體溝通

- 多 GPU 訓練(8張、16張甚至數千張 GPU 串聯的大規模集群)的通訊協議(NCCL)只在 Linux 上有完整支持

Windows 上雖然也能跑 CUDA,但驅動層要經過 Windows Display Driver Model(WDDM)的中轉,多 GPU 的直接通訊支持也遠不如 Linux 上的原生實現。

③ 套件管理與依賴庫生態

AI 開發依賴海量的開源函式庫(PyTorch、TensorFlow、JAX、Hugging Face 等)。這些工具鏈的原生開發環境幾乎全部是 Linux/macOS:

pip、conda、apt-get等套件管理工具在 Linux 上是一等公民- 許多底層 C/C++ 編譯依賴(如 BLAS、MKL、OpenMP)在 Linux 上開箱即用

- 在 Windows 上安裝相同的環境,經常陷入「依賴庫地獄」——版本衝突、路徑問題、編譯器不相容等

雖然這些年情況已改善很多(特別是 WSL2 出現後),但 Linux 的原生體驗仍然遠優於 Windows。

④ 容器化與雲端部署

現代 AI 基礎設施高度依賴容器技術(Docker、Kubernetes)。這些技術的底層是 Linux 的核心功能(cgroups、namespaces)——Docker 本身就是 Linux 原生技術。

在 Windows 上跑 Docker 需要透過 WSL2 或 Hyper-V 虛擬機,額外增加了一層性能損耗和複雜度。而在 Linux 上,容器直接運行在宿主核心之上,幾乎零開銷。

⑤ 歷史共演化:AI 與 Linux 是一起長大的

從 2005 年深度學習萌芽,到 2012 年 AlexNet 用 GPU 訓練圖像識別,到 2017 年 Transformer 架構誕生——AI 的每一個里程碑都發生在 Linux 環境中。整個 AI 研究社群的工具鏈、教材、論文附帶的代碼,全部預設 Linux 環境。

這形成了一個自我強化的循環:AI 研究者用 Linux → 他們開發的工具優先支持 Linux → 下一代研究者也用 Linux → 工具越來越針對 Linux 優化。這不是任何單一技術決策造成的,而是二十年生態演化的結果。

對比總結

| 維度 | Linux | Windows |

|---|---|---|

| 核心設計目的 | 伺服器 + 高效能運算 | 桌面圖形介面 + 多工 |

| GPU 直接控制 | 原生 CUDA,無中間層 | 經過 WDDM 中轉 |

| 多 GPU 集群通訊 | NCCL 完整支持 | 支持有限 |

| 容器化(Docker) | 原生技術,零開銷 | 需透過 WSL2/Hyper-V |

| AI 工具鏈相容性 | 一等公民 | 二等公民(需額外配置) |

| 系統資源開銷 | 極低(無 GUI 強制佔用) | 較高(DWM + 背景服務) |

真正的問題:Windows 這棵搖錢樹在 AI 時代變得無關緊要

理解了 Linux 的技術優勢之後,這道緊箍咒的本質就清楚了——它不是簡單的技術限制問題,而是商業護城河的結構性侵蝕。

Windows 是微軟帝國的基石。四十年來,Windows 的邏輯是:「你必須用我的作業系統,才能用大多數的軟體。」這個「系統綁定」讓微軟建立了人類商業史上最強大的平台壟斷之一。

但在 AI 時代,這個綁定正在崩塌——因為上述五大技術優勢,Linux 成為了 AI 的不二之選:

-

AI 訓練和推理的核心基礎設施全部運行在 Linux 上��。 不管你是 Google、Meta 還是 OpenAI,數據中心裡的 GPU 集群跑的都是 Linux。Windows 在這個層面完全不存在。

-

開發者的工作環境開始脫離 Windows。 AI/ML 工程師的首選工作環境是 macOS(Unix 基因,與 Linux 開發生態無縫相容)或直接用純 Linux。Windows 在 AI 開發者中的市佔率持續下降。

-

終端 AI 的戰場轉向行動裝置和 Mac。 本地端跑開源大模型的玩家首選 Apple Silicon(統一記憶體優勢),或在行動裝置上(iOS/Android)。Windows PC 在「個人端 AI」的定位尷尬。

WSL2:微軟的止血方案

微軟推出 WSL2(Windows Subsystem for Linux)+ GPU 直通技術,本質上是在 Windows 裡面嵌了一個 Linux。這招很聰明——它不是在解決「Windows 做不了 AI」的問題,而是在防止開發者因為要用 Linux 而直接拋棄 Windows。

WSL2 確實大幅改善了 Windows 上的 AI 開發體驗:日常開發和中等規模的模型推理已經完全夠用。但它的本質是一個 Hyper-V 虛擬機,存在 vmmem 記憶體消耗和跨檔案系統 I/O 效能損失等問題。

更深層的問題是:WSL2 的成功恰恰證明了 Windows 原生系統的失敗。 微軟需要在自己的作業系統裡跑另一個作業系統,才能讓開發者留下來——這等於承認 Windows 的核心架構不適合 AI 時代的開發需求。

這對微軟意味著什麼?

Windows 仍然是微軟的重要收入來源(2025 財年 Windows 授權營收約 220 億美元),但它在 AI 價值鏈中沒有位置。當整個 AI 產業——從底層訓練到邊緣推理——都繞過 Windows 運行時,微軟傳統的「平台壟斷 → 生態鎖定」模式就失去了在 AI 時代複製的能力。

微軟已經認識到這一點。它的回應是:把護城河從 Windows 轉移到 Azure + Office/M365 + GitHub。 但正如主題一和主題五所分析的,Azure 受制於 OpenAI 的算力依賴,M365 Copilot 的採用率仍然偏低,GitHub 又面臨 Claude Code 的侵蝕——新的護城河也在受到衝擊。

第四道緊箍咒:Apple 的硬體降維打擊

記憶體牆:AI 本地部署的最大瓶頸

跑 AI 大模型,最大的瓶頸從來不是 CPU 有多快,而是**「記憶體牆」——VRAM 限制**。

一個幾百億參數的開源模型,動輒需要 40-80GB 的 GPU 記憶體才能載入。在傳統 x86 PC 上:

- Nvidia RTX 4090:24GB VRAM,約售價 5 萬台幣——根本不夠跑大模型

- 需要兩三張頂級商用卡(A100/H100)串聯,成本動輒數十萬台幣

Apple ��的「統一記憶體核彈」

Apple Silicon(M 系列晶片)將 CPU/GPU 封裝在一起,共用同一塊高頻寬記憶體。

一台 128GB RAM 的 Mac Studio,整塊 128GB 都可以被當成 GPU VRAM 來跑大模型。用幾萬塊的消費級設備,碾壓了傳統 PC 需要伺服器才能解決的問題。

M4 系列的最新規格(2025-2026):

- Neural Engine 達到 38 TOPS(每秒兆次運算)

- 記憶體頻寬大幅提升

- 支援最高 128GB+ 的統一記憶體配置

配合 Mac 系統底層的 Unix 基因(完美相容 Linux 開發生態),Apple 已成為高階 AI 開發者和本地開源模型玩家的首選桌面平台。

微軟 AI PC 的反擊——但缺乏結構性優勢

微軟也在推「AI PC」概念,與 Qualcomm(Snapdragon X 系列)合作搭載 NPU。但:

- Windows on ARM 的軟體相容性仍是致命傷

- x86 架構(Intel/AMD)的記憶體架構天生不支持 CPU/GPU 共用

- 微軟沒有硬體控制權——它依賴 Intel、AMD、Qualcomm 各自的晶片設計

四道緊箍咒的疊加效應

把四道緊箍咒拼在一起,微軟的�困局就一目了然了:

雲端 → Copilot 體驗碎裂、採用率低 → 賺不回投資

↓

模型 → 依賴 OpenAI,靈魂捏在別人手裡 → 隨時被反噬

↓

系統 → Windows 護城河在 AI 時代失效 → 平台壟斷無法複製

↓

硬體 → x86 被 Apple ARM 降維打擊 → 本地 AI 陣地失守

微軟的確擁有最強的「生態圈」與「分發管道」,但只要底層邏輯算不過帳,佔據再多入口也是徒勞。

在這場殘酷的遊戲中,微軟試圖用無盡的資本強行把雲端、系統、硬體全部縫合在一起。但只要這四道緊箍咒一天不解開,這個 AI 帝國就始終建立在隨時可能崩塌的流沙之上。