主題六:Apple 的靜悄悄反殺——不只是晶片

核心論點

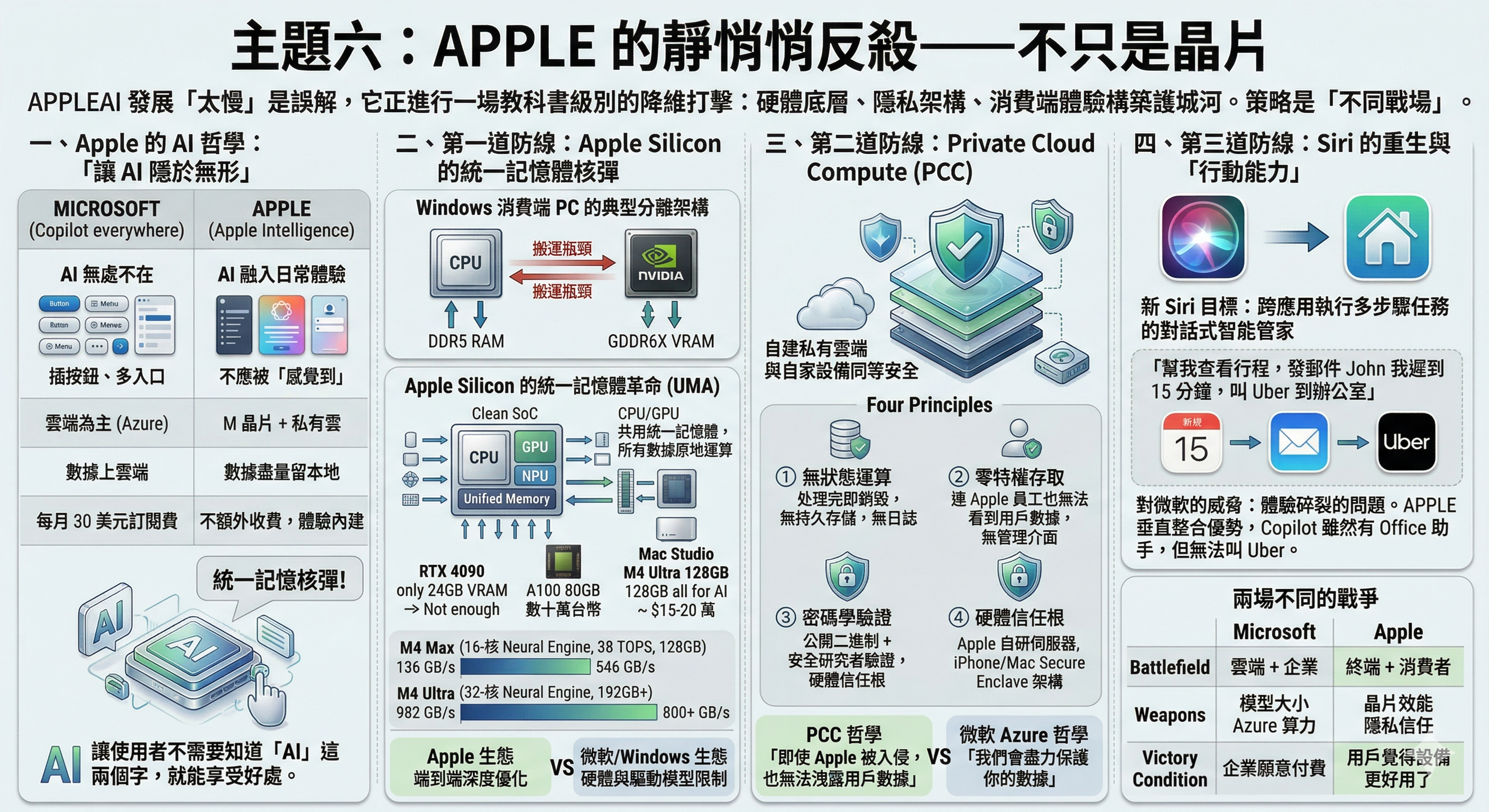

Apple 一直被嘲笑「AI 發展太慢」。但如果你看懂了結構性優勢的邏輯,就會發現 Apple 正在進行一場教科書級別的降維打擊——它不跟微軟搶雲端,卻在硬體底層、隱私架構、和消費端體驗三個維度同時構築了護城河。Apple 的 AI 策略不是「落後」,而是「不同戰場」。

一、Apple 的 AI 哲學:「讓 AI 隱於無形」

與微軟的根本分歧

| 維度 | 微軟 | Apple |

|---|---|---|

| AI 口號 | 「AI 無處不在」(Copilot everywhere) | 「Apple Intelligence」——AI 融入日常體驗 |

| 核心策略 | 在每個產品裡插 AI 按鈕、多入口 | AI 不應被「感覺到」,而應讓事情自然變好 |

| 算力位置 | 雲端為主(Azure) | 本地為主(M 晶片 + 私有雲) |

| 隱私態度 | 數據上雲端處理 | 數據盡量留本地 |

| 商業模式 | 每月 30 美元訂閱費 | 不額外收費,AI 體驗內建在硬體售價中 |

Apple 的策略可以用一句話概括:讓使用者不需要知道「AI」這兩個字,就能享受 AI 帶來的好處。 這和微軟到處貼 Copilot 標籤的做法形成鮮明對比。

二、第一道防線:Apple Silicon 的統一記憶體核彈

技術原理

在 Windows 消費端 PC 的典型配置中,CPU 和獨立 GPU 是分開的組件,各自有獨立的記憶體:

- CPU 用系統 RAM(DDR5)

- 獨立 GPU 用自己的 VRAM(GDDR6X 或 HBM)

- 數據要在兩者之間來回搬運,這個搬運過程就是瓶頸

值得注意的是,這並非所有非 Apple 晶片的「天然限制」。AMD 的 APU(如 Ryzen 8000 系列)內建 GPU 本身就共享系統記憶體;Qualcomm 的 Snapdragon 作為 SoC 也是 CPU/GPU/NPU 共用記憶體。但在 Windows 消費端 PC 的主流使用場景中——尤其是需要高效能 AI 推理時——用戶通常需要搭配獨立顯示卡,於是就回到了分離記憶體的老路。

Apple Silicon 的革命在於:CPU、GPU、Neural Engine、記憶體全部封裝在同一塊晶片上,共用統一記憶體(Unified Memory)。

對 AI 的實際意義

跑一個 700 億參數的開源大模型(如 Llama 3 70B),需要約 35-40GB 的記憶體空間。

在 Windows 消費端 PC 上:

- Nvidia RTX 4090 只有 24GB VRAM → 不夠,跑不了

- 需要 A100 80GB(單卡約 30-50 萬台幣)或多卡串聯

- 即使有足夠 VRAM,系統 RAM 和 VRAM 之間的數據搬運仍是效能瓶頸

在 Mac 上:

- Mac Studio M4 Ultra 128GB 配置 → 128GB 全部可用作 AI 推理

- 不需要獨立顯示卡,不需要 VRAM 搬運——所有數據原地運算

- 售價約 15-20 萬台幣——只有伺服器方案的零頭

但在非 Windows 的專業 AI 領域:

- NVIDIA DGX(��運行基於 Ubuntu 的 DGX OS)透過 NVLink 實現多 GPU 之間的高速記憶體互通,本質上也是一種「統一記憶體池」的方案。DGX 是目前 AI 訓練和推理的業界標準。

- AMD MI300A 將 CPU + GPU + 128GB HBM3 統一封裝在同一塊晶片上,架構理念與 Apple Silicon 異曲同工。

- 這些方案的共同特點是:它們都跑在 Linux 上,而非 Windows。 在 AI 的實際部署場景中,Linux 才是主流作業系統,NVIDIA 的整個 CUDA 生態都是 Linux-first。

M4 系列的最新規格

| 晶片 | Neural Engine | 統一記憶體上限 | 記憶體頻寬 |

|---|---|---|---|

| M4 | 16 核 Neural Engine,38 TOPS | 32GB | 120 GB/s |

| M4 Pro | 16 核 Neural Engine | 48GB | 273 GB/s |

| M4 Max | 16 核 Neural Engine | 128GB | 546 GB/s |

| M4 Ultra | 32 核 Neural Engine | 192GB+ | 800+ GB/s |

38 TOPS(每秒 38 兆次運算) 的 Neural Engine 專門為 AI/ML 運算設計——這是 Apple 從 A11 晶片開始、經過七年迭代的技術積累。

對微軟的降維打擊

微軟的「AI PC」概念依賴 Intel/AMD/Qualcomm 的晶片。問題不在於這些晶片「天然不支持統一記憶體」——事實上,AMD 的 APU 和 MI300A、Qualcomm 的 Snapdragon SoC 都具備不同形式的統一記憶體能力。真正的問題在於 Windows 生態本身成了瓶頸:

| Apple 生態 | 微軟/Windows 生態 | Linux/專業 AI 生態 | |

|---|---|---|---|

| 硬體設計者 | Apple 自己 | Intel / AMD / Qualcomm(三方各自設計) | NVIDIA DGX / AMD MI300 系列 |

| 記憶體架構 | 統一記憶體(CPU/GPU 共用) | 受限於 Windows 驅動模型,消費端仍以分離式為主 | NVLink 互通 / HBM 統一封裝 |

| 作業系統優化 | macOS 針對 Apple Silicon 深度優化 | Windows 需相容千百種硬體組合 | Linux 針對 AI 工作負載深度優化 |

| AI 本地推理 | 無需獨立顯示卡 | 多數場景需 Nvidia 顯示卡 | GPU 叢集為主 |

| 軟體生態 | Unix 基因,原生相容 Linux AI 工具鏈 | WSL2(虛擬機方案)或原生 Windows | CUDA / ROCm 原生支持 |

微軟的根本困境不是「沒有好晶片可用」,而是一個更深層的結構性問題:

- Windows 的向後相容包袱: Windows 的驅動模型和記憶體管理需要相容數十年累積的硬體組合,無法像 macOS 那樣為單一晶片架構做深度優化。AMD 和 Qualcomm 的晶片即使具備統一記憶體的硬體能力,在 Windows 上也難以充分發揮。

- 沒有自己的晶片: 微軟無法像 Apple 一樣從晶片設計到作業系統到應用層做端到端的垂直整合。它只能在三家晶片廠商各自的設計上被動適配。

- AI 主流生態不在 Windows 上: 在專業 AI 開發和部署領域,Linux 才是事實上的標準作業系統。NVIDIA DGX 跑 DGX OS(基於 Ubuntu),AI 框架(PyTorch、TensorFlow)都是 Linux-first。微軟的 WSL2 雖然彌補了一部分差距,但終究是虛擬化方案,並非原生。

Apple 的真正優勢��不是「只有它能做統一記憶體」——而是它同時控制了晶片、作業系統、和軟體生態,能端到端地最佳化整個體驗鏈。 這是 Windows 生態在結構上做不到的事。

三、第二道防線:Private Cloud Compute(PCC)

為什麼需要私有雲端

即使 Apple 的晶片再強,某些複雜的 AI 任務仍然超出本地設備的運算能力。比如大規模的文字生成、複雜的圖像理解等,可能需要更強大的雲端模型。

傳統做法是把數據送到 AWS、Azure 或 Google Cloud 去處理。但這與 Apple 的隱私承諾直接矛盾——用戶的數據離開了自己的設備,進入了第三方的伺服器。

Apple 的解決方案:自建一套與自家設備同等安全級別的私有雲端運算基礎設施。

PCC 的安全架構(經 Apple 官方和第三方安全研究者驗證)

原則一:無狀態運算

- 數據僅用於完成當��次請求,處理完畢後立即銷毀

- 沒有持久化存儲、沒有日誌、沒有用戶行為追蹤

- 每次重啟節點時,數據卷都會被密碼學方式清除

原則二:零特權存取

- Apple 移除了 PCC 節點上所有的管理介面(SSH、遠端 Shell、除錯工具)

- 即使 Apple 員工擁有硬體的物理存取權,也無法接觸用戶數據

- 這點與 Azure / AWS 的模式根本不同——在那些平台上,雲端供應商的管理員理論上可以接觸到客戶數據

原則三:密碼學驗證

- 用戶設備在發送任何數據之前,先驗證 PCC 集群的身份和軟體配置

- PCC 運行的二進制文件是公開的、密碼學簽名的,安全研究者可以驗證伺服器上實際運行的軟體是否與 Apple 的承諾一致

原則四:硬體信任根

- PCC 運行在 Apple 自家設計的伺服器硬體上,使用與 iPhone/Mac 相同的 Secure Enclave 架構

- 從硬體層開始建立不可篡改的加密信任鏈

對比微軟 Azure 的模式

| 維度 | Apple PCC | 微軟 Azure / Copilot |

|---|---|---|

| 數據留存 | 完全不留存 | 依企業設定,雲端可能留存 |

| 管理存取 | 連 Apple 自己也無法看到 | 雲端供應商理論上可接觸 |

| 硬體 | Apple 自研伺服器 | 通用伺服器硬體 |

| 驗證性 | 公開二進制 + 安全研究者環境 | 依合規報告與審計 |

| 哲學 | 「即使 Apple 被入侵,也無法洩露用戶數據」 | 「�我們會盡力保護你的數據」 |

Apple 開放安全研究: Apple 提供了虛擬研究環境(VRE),讓安全研究者可以在虛擬化環境中運行和檢查 PCC 軟體棧。同時將 Apple 安全賞金計劃擴展至 PCC,獎勵發現漏洞的研究者。

四、第三道防線:Siri 的重生

從笑柄到威脅

Siri 長期以來是 Apple AI 策略中最大的笑柄——笨拙的語音助手,遠不如 ChatGPT 或 Google Assistant 聰明。

但 Apple 正在用本地 LLM + 選擇性雲端處理(PCC)全面重建 Siri。2026 年是這個重建計劃的關鍵年份。

新 Siri 的目標

不再是「語音搜尋工具」,而是能跨應用執行多步驟任務的對話式智能管家:

- 「幫我查看今天的行程,然後發一封郵件給 John 說我會遲到 15 分鐘,順便叫一輛 Uber 到辦公室」

- 一句話,跨越日曆、郵件、第三方 APP 三個應用,執行三個步驟

為什麼這對微軟是威脅

這恰好是微軟 Copilot 在消費端一直想做、但因為「體驗碎裂」做不好的事。

Apple 的垂直整合優勢在這裡展現得淋漓盡致:

- Apple 控制硬體(iPhone/Mac)→ 能深度優化 AI 推理效能

- Apple 控制作業系統(iOS/macOS)→ 能讓 AI 跨應用操作

- Apple 控制開發者框架(SiriKit/App Intents)→ 能定義第三方 APP 如何與 AI 互動

微軟控制的是 Windows 和 Office,但它不控制硬體、不控制手機、也不控制用戶的大部分消費級應用。它的 Copilot 能在 Word 裡幫你寫文件,但它連幫你叫一輛 Uber 的能力都沒有。

五、Apple 的隱藏風險

公平地說,Apple 的 AI 戰略也有明顯風險:

-

雲端 AI 的能力差距: Apple 沒有自己的前沿大模型(GPT、Claude、Gemini 級別),PCC 上跑的模型能力可能落後於頂尖玩家。Apple 與外部夥伴的合作(例如整合 ChatGPT)部分緩解了這個問題,但引入第三方模型與 Apple 的隱私承諾之間存在張力。

-

開發者生態的封閉性: Apple 的封閉生態讓第三方 AI 工具很難深度整合到 macOS/iOS 的底層。這保護了 Apple 的控制權,但也限制了創新的速度。

-

Siri 重建的執行風險: Apple 已經多次承諾「Siri 大改版」但未能兌現。如果 2026 年的新 Siri 再次令人失望,市場會對 Apple 的 AI 能力徹底失去耐心。

六、結論:兩場不同的戰爭

微軟和 Apple 看似在打同一場 AI 戰爭,實際上它們在完全不同的戰場上:

| 微軟的戰爭 | Apple 的戰爭 | |

|---|---|---|

| 戰場 | 雲端 + 企業 | 終端 + 消費者 |

| 武器 | 模型大小、Azure 算力 | 晶片效能、隱私信任 |

| 勝利條件 | 企業願意為 Copilot 付費 | 用戶覺得「設備更好用了」 |

| 最大風險 | ROI 無法證明 | Siri 再次失敗 |

Apple 不需要贏得雲端的戰爭。它只需要做到一件事:讓用戶覺得,買一台 Mac 或 iPhone 後,AI 就「天然存在」於自己的設備中,不需要額外付費、不需要擔心隱私、不需要學習新工具。

如果 Apple 成功了,微軟會發現:它花了數百億美元在雲端建立的 AI 帝國,正在被一個完全不跟它搶雲端的對手,從終端用戶的口袋裡一點一點地搶走。